Facebook behauptet, mit einem neuen System einen Durchbruch erzielt zu haben, das nicht nur Deepfakes erkennt, sondern auch die manipulierten Medien zurückentwickeln kann, um die KI-Engine zu finden, mit der sie erstellt wurden, und schließlich sogar helfen, den bösen Akteur dahinter aufzuspüren. Deepfakes haben sich als ausgeklügelte Methode zur Verbreitung von Fehlinformationen entwickelt und können sich in verschiedenen Formen manifestieren, wie zum Beispiel gefälschte verleumderische Bilder bis hin zu fabrizierten Videos für Erwachsene. Das ist jedoch nur die Spitze des Eisbergs. Die schädlichen Auswirkungen sind endlos und besorgniserregend genug, dass sogar das FBI vor dem Potenzial von Deepfakes gewarnt hat, für Operationen mit ausländischem Einfluss als Waffe eingesetzt zu werden. Deepfakes wurden mit amüsanten Ergebnissen verwendet, aber der Umfang des Missbrauchs ist groß.

In der Forschungsgemeinschaft wird daran gearbeitet, die Bedrohung durch Deepfakes zu bekämpfen, die mit böswilliger Absicht erstellt wurden, und Technologiegiganten helfen dabei. Microsoft hat beispielsweise ein KI-basiertes Microsoft Video Authenticator-Tool entwickelt, um Deepfakes zu erkennen. Im vergangenen Jahr hat Facebook damit begonnen, manipulierte Medien von seiner Plattform zu entfernen, die irreführend sein und die Meinungen der Menschen vor den Präsidentschaftswahlen beeinflussen könnten. Jetzt verstärkt der Social-Media-Gigant sein Spiel gegen diese Bedrohung.

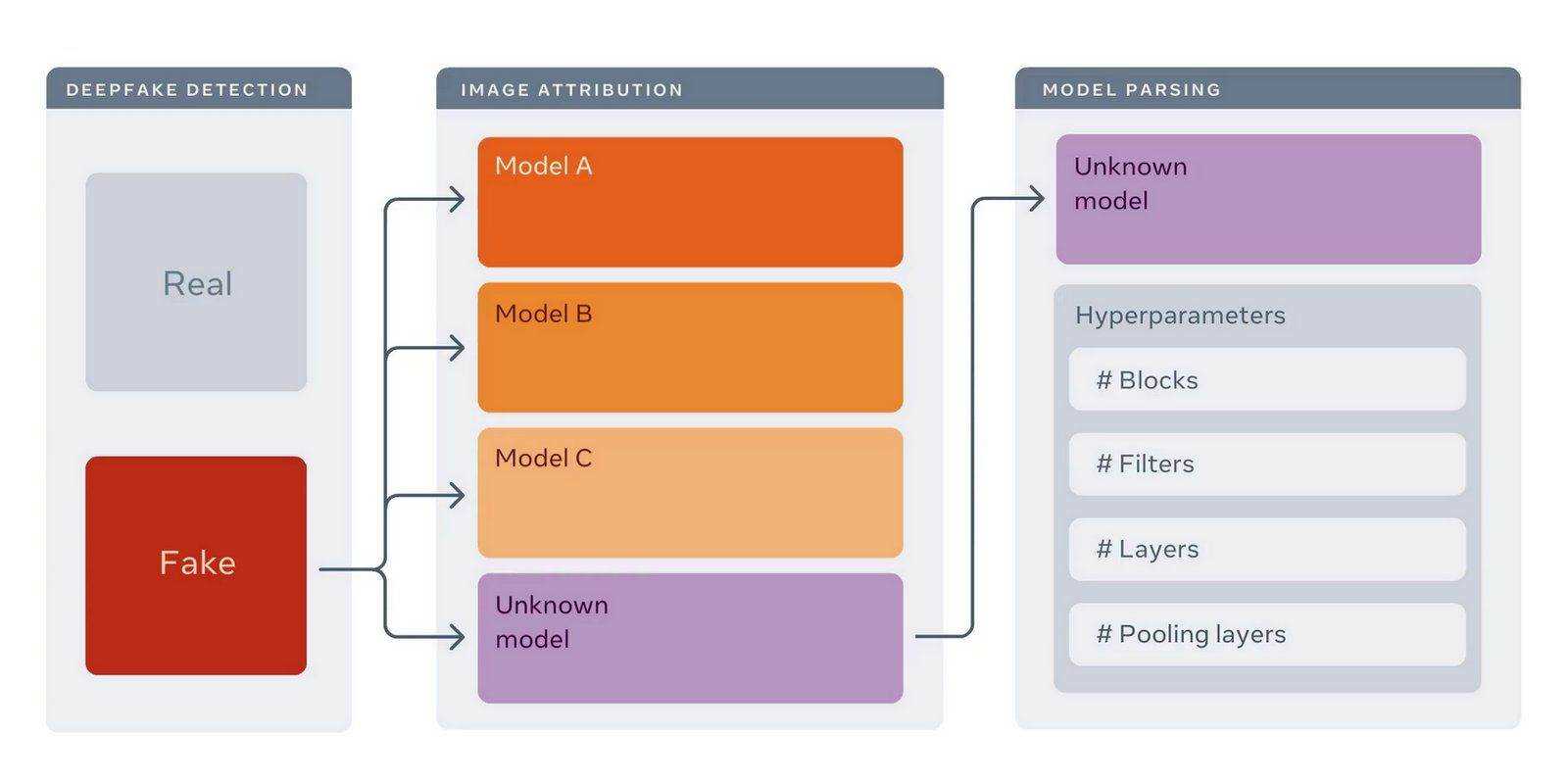

Entwickelt in Zusammenarbeit mit Forschern der Michigan State University (MSU), dem KI-basierten System von Facebook Facebook identifiziert manipulierte Medien und setzt dann Reverse Engineering ein, um das generative Modell zu erkennen, mit dem der Deepfake erstellt wurde. Das ultimative Ziel ist es, die Deepfake-Generierungssoftware auf einen Computer und damit auf den Schuldigen dahinter zu verfolgen. Facebook stellt fest, dass sein Modell im Wesentlichen nach einzigartigen Fingerabdrücken sucht, die ein generatives Modell in einem Meer manipulierter Medien hinterlassen hat, und dann den Ursprungsort identifiziert.

Facebook tritt in die Fußstapfen von Forensikern, die nach bestimmten Mustern in Bildern suchen, um das Kameramodell zu identifizieren, mit dem auf eine bestimmte Bildgruppe geklickt wird. In diesem Fall sucht die von Facebook- und MSU-Forschern entwickelte Methode nach einzigartigen Attributen, die das dahinterstehende generative Modell auf manipulierten Medien hinterlassen hat. Faktoren wie Größe des Fingerabdrucks, repetitive Natur, Frequenzbereich und symmetrischer Frequenzgang werden verwendet, um ein vollständiges Fingerabdruckprofil zu erstellen, das anschließend zum Erfassen der Hyperparameter der generativen Modelle verwendet wird. Forscher setzen diese Hyperparameter mit Motorteilen gleich, während das generative Modell mit einem Auto verglichen wird, das diese Motorteile verwendet. Vor ein paar Jahren hat Google einen umfangreichen Datensatz mit Deepfake-Videos veröffentlicht, um auch die Forschung auf diesem Gebiet zu unterstützen.

Facebook sagt, dass das von ihm verwendete Modell-Parsing-System effizienter ist, wenn es um den realen Einsatz der Technologie durch Strafverfolgungsbehörden und Cybersicherheitsexperten geht. Besonders nützlich sei die neue Methode in Szenarien, in denen ein Fundus an manipulierten Medien die einzige Ressource sei, die Experten und Behörden zur Verfügung stünde. Das Endziel besteht darin, bessere Ermittlungsinstrumente zu entwickeln, auf die man sich verlassen kann, um groß angelegte Desinformationskampagnen mit Deepfakes zu bekämpfen.

Da sich die Technologie hinter Deepfakes rasant weiterentwickelt, sind Lösungen, wie sie Facebook jetzt angekündigt hat, umso wichtiger. Facebook sagt, dass das neue System Open-Source für die Forschungsgemeinschaft sein wird, wobei MSU den Datensatz, den Code und die trainierten Modelle freigibt, damit andere helfen können, effizientere Deepfake-Tracing-Methoden weiterzuentwickeln.

Quelle: Facebook