Kommunikationssicherheit: Verwischen sensibler (Nackt-)Fotos, die Sie senden oder empfangen

Eines der größeren Updates in iOS 17 betrifft die Kommunikationssicherheit, also die Funktion, die „sensible“ Fotos (sprich: mit Nacktfotos) auf dem Weg in oder aus dem iPhone oder iPad eines Kindes automatisch erkennt und unkenntlich macht.

Warnung Erwachsene

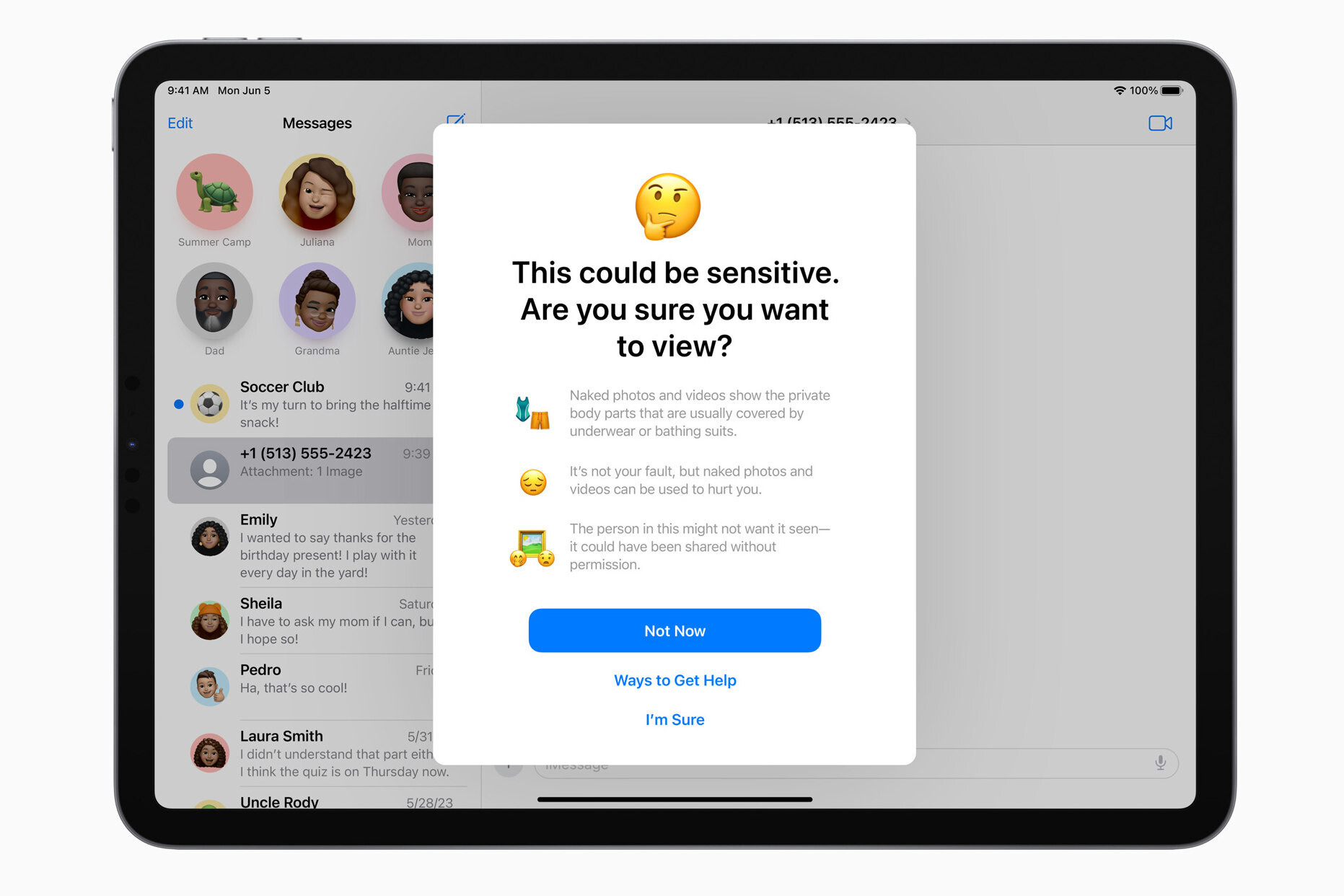

Mit iOS 17 können Erwachsene sich Warnungen anzeigen lassen, wenn jemand versucht, ihnen sensibles Material zu senden

Und während der Kommunikationssicherheitsfilter in erster Linie eine Kindersicherungsfunktion bleibt, um Kinder so sicher wie möglich zu halten, wird es iOS 17 ermöglichen, den Komfort der Kommunikationssicherheit auch auf dem iPhone eines Erwachsenen zu aktivieren. Das bedeutet, dass Sie jedes Mal, wenn ein sensibles Foto oder Video an Ihr Gerät gesendet oder empfangen werden soll, eine Warnung und einen Unschärfefilter aktivieren möchten.

Auch wenn man als Erwachsener völlig frei ist, beliebige Inhalte auf seinem Telefon zu senden und zu empfangen, kann ich mir vorstellen, dass diese Option von vielen Menschen da draußen als praktisch und nützlich angesehen wird. Zumindest bedeutet es, dass Sie sich den Schock ersparen können, unerwartet ein Nacktfoto von jemandem zu erhalten, von dem Sie nie gedacht hätten, dass Sie ihm so nahe stehen.

Generell wäre ich überrascht, wenn zu viele tatsächlich der Versuchung widerstehen würden, genau zu überprüfen, was sie erhalten haben, aber darum geht es nicht. Wenn Sie darüber nachdenken, möchten manche Menschen vielleicht nichts mit den „sensiblen Teilen“ von Fremden oder … den meisten anderen Menschen zu tun haben, und das ist ein Recht, das absolut schützenswert ist.

„Standardmäßig aktiviert“ für Kinder unter 13 Jahren

Die aktuelle Richtlinie sah vor, dass die Kommunikationssicherheit standardmäßig deaktiviert ist. Da Eltern jetzt jedoch Konten für ihre Kinder unter 13 Jahren erstellen und diese zur Familienfreigabe hinzufügen, sind alle Sicherheitsfilter und Benachrichtigungen standardmäßig aktiviert.

Kinder unter 13 Jahren können keine eigenen Apple-IDs erstellen – sie müssen von den Eltern hinzugefügt werden; während die Kindersicherung in der Familienfreigabe funktioniert, bis Kinder 18 Jahre alt sind.

Über Nachrichten hinaus wachsend: AirDrop, FaceTime und Apps von Drittanbietern

Warnung vor sensiblen Inhalten auf dem iPad

Nun, all dieses Gerede über den Schutz von Kindern, Ihr Recht, keinem expliziten Material ausgesetzt zu werden usw. würde nicht viel nützen, wenn sich alles nur auf Apple Messages beschränken würde, oder? Aus diesem Grund erweitert Apple alle Kommunikationssicherheitsfunktionen auf andere iOS-Apps und -Funktionen wie AirDrop, FaceTime, die systemweite Fotoauswahl und die neuen Kontaktposter.

Derzeit gibt es keine offiziellen Informationen über beliebte Messaging-Apps, die an der Integration der Analyse sensibler Inhalte arbeiten, aber offenbar testen einige Entwickler bereits das Wasser, wobei das Discord-Team dem ziemlich positiv gegenübersteht, wie ein Apple-Vertreter erwähnte.

Global expandieren

Nach der exklusiven Einführung in den USA Ende 2021 wurde die Verfügbarkeit von Communication Safety zweimal ausgeweitet, um mehrere andere wichtige Märkte abzudecken, darunter Großbritannien, Kanada, Deutschland, Belgien, Japan und Südkorea.

Mit iOS 17 wird die Nackterkennungsfunktion nun weltweit verfügbar sein, sodass Benutzer sie nutzen können (wenn sie möchten), unabhängig davon, wo sie sich befinden.

Wir leben in einer Welt, in der Nacktheit fast zur Normalität geworden ist und man es kaum vermeiden kann, mit expliziten Bildern (und Videos) bombardiert zu werden, egal wie alt man ist. Eltern können ihren Teil dazu beitragen, den Kontakt ihrer Kinder mit solchem Material zu begrenzen, und natürlich können solche Bemühungen viel bewirken, aber dieser Schutzschild ist alles andere als undurchdringlich. Deshalb ist es von großem Nutzen, die größten Technologieunternehmen der Welt an Ihrer Seite zu haben.