Tesla‘s Full Self-Driving (FSD) Beta 9 wird in einem aktuellen YouTube-Video in den überfüllten Straßen von San Francisco auf die Probe gestellt, aber es scheint noch ein paar Knicke zu lösen. Autonomes Fahren im Allgemeinen ist ein kniffliges Konzept, und bei so vielen verschiedenen Szenarien und Tausenden von Dingen, die schiefgehen könnten, muss die Technologie viele Variablen berücksichtigen. Wenn sie im wirklichen Leben auf die Probe gestellt werden, sind viele dieser Probleme und Fehler leicht zu erkennen und können möglicherweise ernsthaften Schaden anrichten.

Tesla arbeitet seit einiger Zeit an FSD, veröffentlicht Beta-Updates und passt die Technologie schrittweise an. Die Technologie ist inzwischen für Tesla-Besitzer weit verbreitet, je nachdem, welches Modell sie besitzen und welche Art von Autopilot-System installiert ist. Benutzer mit dem Basic Autopilot-System können 199 US-Dollar pro Monat für FSD zahlen, oder diejenigen, die die Advanced Autopilot-Hardware installiert haben, können monatlich 99 US-Dollar zahlen. Alternativ kann FSD für 10.000 US-Dollar direkt hinzugefügt werden. In jedem Fall kann ein Tesla mit installiertem und einsatzbereitem FSD einige zugegebenermaßen ziemlich nette Funktionen haben. Leider sieht es noch nicht fertig oder sicher für die Straße aus, obwohl Benutzer die FSD-Beta greifen und ausprobieren können.

In einem Video, YouTuber KI-Süchtiger präsentierte das neue Beta 9-Update für FSD in Aktion auf den oft komplizierten Straßen von San Francisco. Auf Anhieb biegt das Tesla Model 3 in eine Nur-Bus-Spur ein. Dann ist beim Einfahren in eine Abbiegespur zu sehen, wie das Auto in den Verkehr ausweicht, nachdem ein SUV auf der rechten Seite erkannt wurde. Das Video zeigt auch mehrere Fälle, in denen der Autopilot deaktiviert wurde, nachdem das Auto plötzlich beschloss, den Fahrer übernehmen zu lassen. Irgendwann wird ein Busch neben dem Tesla aufgerauht, obwohl er als Hindernis hätte betrachtet und vermieden werden sollen – etwas, das Radar aufgenommen haben könnte. Das Video zeigt mehr als ein paar interessante Vorfälle, die alle sehr schlecht hätten enden können.

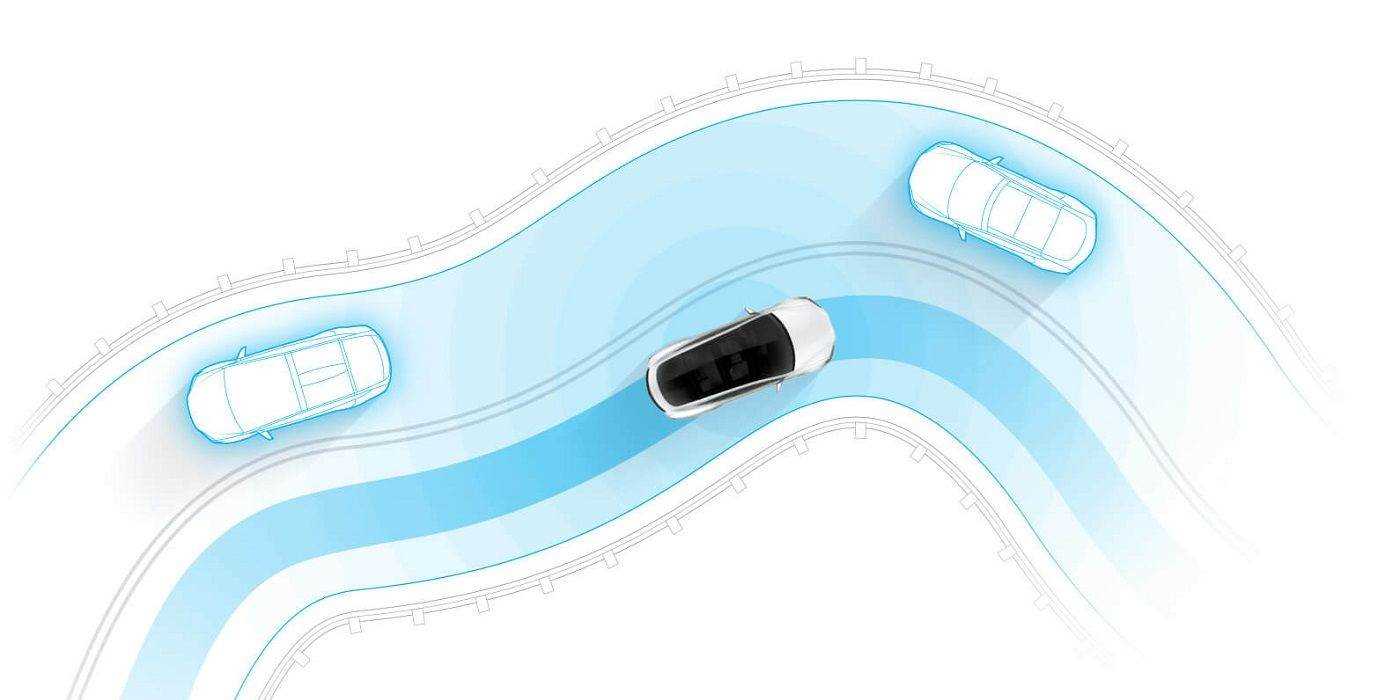

Teslas FSD – oder jede Form des Selbstfahrens – muss Tausende von Informationen gleichzeitig verarbeiten. Ob diese Informationen korrekt verarbeitet werden oder nicht, kann den Unterschied zwischen einem Beinahe-Unfall und einer Kollision ausmachen. Offensichtlich ist das Video voller Beinahe-Unfälle und ohne die schnellen Reaktionen des Fahrers hätte das Ergebnis schlimmer ausfallen können. Bei FSD Beta 9 setzt die Verarbeitung auf Tesla Vision-Kameras statt auf Sensoren beim Model Y und Model 3. Diese Kameras können feststellen, ob das vorausfahrende Fahrzeug seine Bremslichter hat oder nicht und können zwischen rotem, gelbem und grünem Verkehr unterscheiden distinguish Signale. Die Kameras erfassen auch ungewöhnliche Objekte im Weg, wie Baustellenschilder oder Fußgänger auf der Straße, um in deren Nähe Vorsicht walten zu lassen. Obwohl das Tesla Model 3 das meiste davon gut genug zu machen scheint, kann selbst ein einziger Fehler einer zu viel sein.

Natürlich ist es eine Beta und es wird daher einige Probleme geben, die bearbeitet werden müssen. Das Video zeigt sehr gut viele der Probleme, die auftreten können, und in einer Zeitspanne von 30 Minuten Fahrt hat es viele getan. Es ist erwähnenswert, dass San Francisco aufgrund der ungewöhnlichen Fahrspuranordnungen, des starken Fahrzeug- und Fußgängerverkehrs und der großen Höhenunterschiede wahrscheinlich eine der schwierigsten Gegenden ist, um FSD Beta 9 auszuprobieren. Trotzdem hat Tesla viel zu tun, wenn FSD zuverlässig genug wird, um von einer Mehrheit der Fahrer sicher verwendet zu werden, und das weiß sogar Elon Musk.

Quelle: KI-Süchtiger/YouTube