Melden Sie sich an für Tägliche Nachrichten-Updates von CleanTechnica per E-Mail. Oder Folgen Sie uns auf Google News!

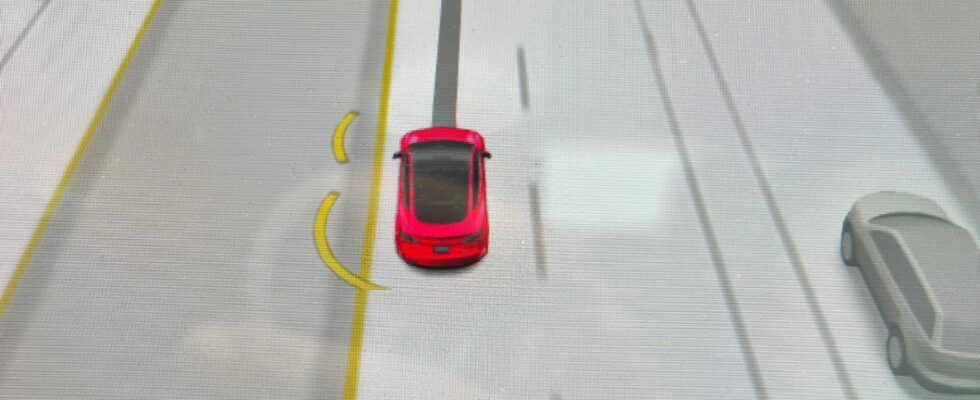

Da Tesla Full Self Driving (FSD) Version 12.3 viel natürlicher und benutzerfreundlicher ist als frühere Versionen, nutze ich es häufiger, um den Fortschritt zu verfolgen und zu versuchen, es besser zu verstehen. Es macht immer noch viel mehr Spaß, das Auto selbst zu fahren, aber die Technik ist wirklich erstaunlich, ein Wunder. Das erreichte Niveau zu erreichen, ist eine sehr coole Leistung.

Allerdings komme ich immer wieder zu meiner Sorge zurück, dass sowohl der Hardware-Ansatz als auch der Software-Ansatz für Robotaxi-Dienste unzureichend sind.

Ein Hauptproblem besteht darin, dass die Kameras einfach nicht immer gut genug sehen können, damit FSD funktionieren kann. Ich habe nur einen einzigen Tesla, nicht 100, 1000 oder eine Million. Für einen sicheren Robotaxi-Service benötigen Sie Hardware, die in jedem FSD-Tesla auf der Straße weit über 99 % der Zeit funktioniert. Wenn mein einziges Auto von der Hardware her nicht ausreicht, ist klar, dass wir Lichtjahre vom Ziel entfernt sind. Neulich regnete es leicht. Es ist noch kein Sommer und wir werden noch nicht von gewaltigen Gewittern heimgesucht, die meiner Meinung nach zu ernsthaften Sichtproblemen führen werden. Es regnete recht leicht. Ich habe versucht, FSD einzuschalten, um zu sehen, wie es unter diesen Bedingungen funktioniert. Es ließ sich nicht einschalten. Anscheinend war der leichte Regen eine zu große Herausforderung für die Kameras meines Autos.

Das gibt es also.

Es gibt das Argument, dass die KI selbst mit aktueller Hardware unter immer schwierigeren Bedingungen arbeiten kann, je mehr die neuronalen Netze arbeiten, je mehr Daten Tesla verarbeitet und sich verbessert. Ich bin nicht verkauft. Ich glaube, dass es zu schwierig ist, sich auf Kameras zu verlassen. Ich sehe genug „Edge Cases“ (eigentlich würde ich sie „Common Edge Cases“ nennen), sodass ich „nur Vision“ nicht für ausreichend halte. Ich kann mich irren. Die Leute in der Branche glauben, dass ich falsch liege. Andere Leute auf diesem Gebiet glauben, dass ich Recht habe – oder ich sollte sagen, sie sind derselben Meinung.

Auch die Sonneneinstrahlung am frühen Morgen und am späten Tag verursacht Sichtprobleme. Auch hier gilt: Wenn Teslas Kameras und das FSD-System mit diesen Problemen konfrontiert werden, könnte es einen Weg finden, sie zu umgehen, genau wie Menschen es tun, aber da bin ich im Moment nicht zuversichtlich. Zumindest müssen wir anerkennen, dass es ein Problem ist Heute. Wir können alle unterschiedlicher Meinung über die Fähigkeit von Tesla AI sein, das Problem rechtzeitig zu lösen.

Als ich heute Morgen X/Twitter durchsucht habe, um zu sehen, welche Tesla-Diskussionen dort stattfinden, bin ich auch auf diese beiden Tweets gestoßen:

Prüfer:

FSD 12.3.4 bog von einer geraden Fahrspur, die von einem sehr beliebten Parkplatz eines Einkaufszentrums kam, nach links ab. Jemand war direkt neben mir auf der richtigen Linksabbiegespur und wurde abgeschnitten. Sprechen Sie über _unbeholfen_! 😬

12.3.4 versuchte auch, an einer grünen Ampel anzuhalten, wobei es fast zu einem Auffahrunfall kam …

— Jack Hopman (@jackhopman) 11. April 2024

Meine Frau fuhr mit aktiviertem FSD 12.3.4. Dies ist eine Zwei-Wege-Haltestelle mit schnellem Querverkehr von über 60 Meilen pro Stunde. Es ist eine gefährliche Kreuzung.

Auf der linken Seite stand ein Auto, das darauf wartete, nach links abzubiegen, und darauf wartete, dass der Gegenverkehr frei wurde. Unser Tesla sprang mitten auf die Straße und hatte… pic.twitter.com/oQD7uIyWF1

– Simon (@_Falcon_Fury) 15. April 2024

1. „FSD 12.3.4 bog von einer geraden Fahrspur, die von einem sehr beliebten Parkplatz eines Einkaufszentrums kam, nach links ab. Jemand war direkt neben mir auf der richtigen Linksabbiegespur und wurde abgeschnitten. Sprechen Sie über _unbeholfen_!„

Von der falschen Spur abzubiegen und einem anderen Auto den Weg abzuschneiden, ist nicht gut. Meiner bescheidenen Meinung nach ist es schockierend, dass dies immer noch geschieht. Vielleicht wird es bald gelöst und das passiert nicht mehr. Aber es ist immer noch ein ernstes Problem und äußerst gefährlich.

2. „12.3.4 versuchte außerdem, an einer grünen Ampel anzuhalten, was fast zu einem Auffahrunfall führte.“

Das ist für mich noch schockierender und noch besorgniserregender. Wie kann das System in manchen Situationen dennoch eine grüne Ampel mit einer roten Ampel verwechseln? Wie schlecht sind die Kameras unter bestimmten Bedingungen oder auf bestimmte Weise, wenn dies geschieht? Wenn es sich um ein reines Softwareproblem und nicht um ein Hardwareproblem handelt, was zum Teufel ist dann schief gelaufen? Von allen Problemen, die bei Version 12.3 immer noch auftraten, ist dieses dasjenige, das mich am meisten schockiert und beunruhigt.

3. „Auf der linken Seite stand ein Auto, das darauf wartete, nach links abzubiegen, und darauf, dass der Gegenverkehr frei wurde. Unser Tesla sprang mitten auf die Straße und hatte einen Weg geplant, der zweifellos zu einem schweren Verkehrsunfall mit dem schnell fahrenden SUV geführt hätte, wenn meine Frau nicht auf die Bremse getreten wäre.“

Dieses Problem scheint etwas zu sein, das in Zukunft mit wachsender Daten- und Verarbeitungsmenge gelöst und vermieden werden könnte. Es ist jedoch der gruseligste Fehler, den ich bei der aktuellen Version von FSD gesehen habe – es scheint, dass etwas mehr Vertrauen in die Arbeit von FSD oder etwas weniger Aufmerksamkeit des Fahrers und Menschenleben hätten beendet werden können. Es lässt mich denken, dass wir jeden Tag einen sehr klaren, herzzerreißenden und öffentlichen FSD-Tod erleben könnten. Und was würde das übrigens für den Fortschritt von Tesla FSD bedeuten?

Robotaxis gleich um die Ecke?

Ich behaupte nicht zu wissen, was in den kommenden Monaten und Jahren mit Tesla FSD und möglichen Robotaxis passieren wird. Ich habe zu viel gesehen und mir zu viele Argumente auf beiden Seiten angehört. Wenn ich jetzt jedoch gezwungen wäre, eine Vermutung anzustellen, würde ich vermuten, dass Teslas Ansatz (wieder) nicht funktionieren wird und eine ernsthafte Umstrukturierung erfordern wird. Ja, das System löst einige Probleme, wenn es sich ändert, aber ich mache mir immer noch Sorgen, dass es im Laufe der Zeit auch andere Probleme schafft. Ich mache mir Sorgen über das, was ich geschrieben habe vor wenigen Monaten vor fast zwei Jahren – ein „See-Säge-Problem“ von Lösungen in bestimmten Fällen, das in anderen, sehr ähnlichen, aber entscheidend unterschiedlichen Fällen zu Fehlern führt. (Ich bin tatsächlich schockiert, als ich erfahre, dass ich diesen Artikel geschrieben habe vor fast zwei Jahren.)

Eigentlich empfehle ich, die Kommentare dort durchzugehen. Viele Leute verteidigten Teslas Ansatz und behaupteten, Elon wisse (wie immer) am besten, welchen Ansatz das Unternehmen damals verfolgte. Es stellte sich heraus, dass dieser Ansatz unzureichend war und schließlich verworfen wurde. Wer hatte also damals Recht? Hätten wir dann einfach Elon und seinen KI-Fähigkeiten vertrauen sollen? Hätten wir ihm und dem Tesla-Team, mit dem er im Jahr 2020 oder im Jahr 2018 zusammengearbeitet hat, einfach vertrauen sollen? Man könnte sagen, was Tesla damals getan hat, hat auf klare und nützliche Weise dorthin geführt, wo wir jetzt sind, und dass wir dort beginnen mussten, um hierher zu gelangen. Okay, das ist ein Argument. Allerdings sollten wir damit rechnen Jetzt Der Ansatz ist richtig und wir brauchen einfach mehr Zeit und Daten? Ja, das System ist heute besser als früher, aber es ist immer noch so weit von der Robotaxi-Fähigkeit entfernt, dass meiner Meinung nach ein sehr großer Vertrauensvorschuss – ein rücksichtsloser Vertrauensvorschuss – erforderlich ist, um anzunehmen, dass Tesla jetzt auf dem perfekten Weg ist. oder der richtige Weg zur Robotaxi-Fähigkeit.

Auch hier empfehle ich für zusätzlichen Spaß dringend, den Kommentarthread zu diesem Artikel noch einmal zu durchsuchen.

Haben Sie einen Tipp für CleanTechnica? Möchten Sie Werbung machen? Möchten Sie einen Gast für unseren CleanTech Talk-Podcast vorschlagen? Kontaktieren Sie uns hier.

Neuestes CleanTechnica.TV-Video

CleanTechnica verwendet Affiliate-Links. Sehen Sie sich hier unsere Richtlinien an.