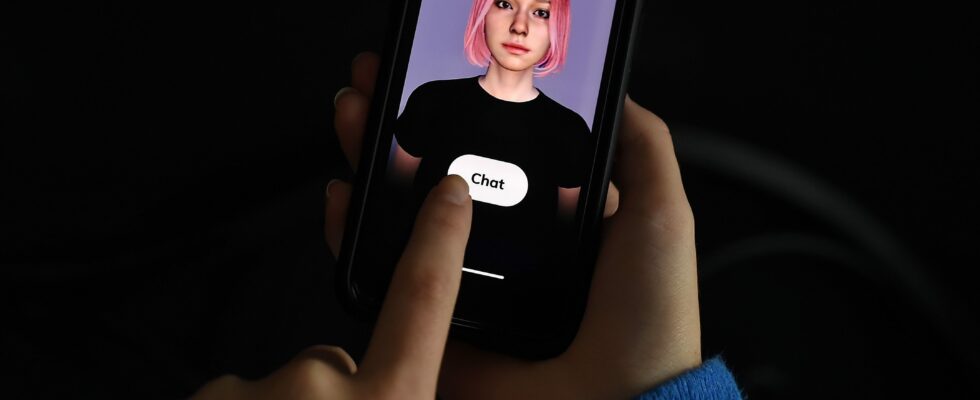

Getty Images

- Eine Umfrage im aufstrebenden Bereich der KI-Romantik-Apps brachte eine beängstigende Wahrheit ans Licht.

- Laut einer Studie der Mozilla Foundation fördern die Chatbots „Toxizität“ und stehlen unermüdlich Benutzerdaten.

- Eine App kann Informationen zur sexuellen Gesundheit, zu Rezepten und zur geschlechtsspezifischen Pflege der Benutzer sammeln.

Laut einer neuen Studie zum Thema Valentinstag lauert unter der Fassade der KI-Romanze eine potenziell gefährliche Realität, die zu dem Schluss kommt, dass Chatbots ein Albtraum für die Privatsphäre sein können.

Internet-Nonprofit-Organisation The Mozilla Foundation zog Bilanz der aufkeimenden Landschaft, überprüfte 11 Chatbots und kam zu dem Schluss, dass alle nicht vertrauenswürdig waren – und fielen in die schlechteste Kategorie von Produkten, die es auf Datenschutz überprüfte.

„Obwohl sie als etwas vermarktet werden, das Ihre geistige Gesundheit und Ihr Wohlbefinden verbessert“, schrieb der Forscher Misha Rykov in dem Bericht über romantische Chatbots, „spezialisieren sie sich darauf, Abhängigkeit, Einsamkeit und Toxizität zu vermitteln und dabei so viele Daten wie möglich auszuspionieren.“ von dir.”

Laut einer Marktumfrage teilen 73 % der Apps nicht mit, wie sie Sicherheitslücken verwalten, 45 % erlauben schwache Passwörter und alle bis auf eine (Eva AI Chat Bot & Soulmate) geben persönliche Daten weiter oder verkaufen sie.

Darüber hinaus heißt es in der Datenschutzrichtlinie von CrushOn.AI, dass es gemäß der Mozilla Foundation Informationen über die sexuelle Gesundheit der Benutzer, verschreibungspflichtige Medikamente und geschlechtsspezifische Pflege sammeln kann.

Einige Apps verfügen über Chatbots, deren Charakterbeschreibungen auf Gewalt oder Missbrauch von Minderjährigen hinweisen, während andere davor warnten, dass die Bots unsicher oder feindselig sein könnten.

Die Mozilla Foundation stellte fest, dass Apps in der Vergangenheit gefährliches Verhalten gefördert hatten, darunter Selbstmord (Chai AI) und ein Attentat auf die verstorbene Königin Elizabeth II. (Replika).

Eva AI Chat Bot & Soulmate und CrushOn.AI antworteten nicht auf die Bitte von Business Insider um einen Kommentar. Ein Vertreter von Replika sagte gegenüber BI: „Replika hat nie Benutzerdaten verkauft und hat auch nie Werbung unterstützt. Die einzige Verwendung von Benutzerdaten besteht darin, Gespräche zu verbessern.“

Für diejenigen, die der Aussicht auf KI-Romanze nicht widerstehen können, rät die Mozilla Foundation zu mehreren Vorsichtsmaßnahmen: Sagen Sie nichts, was ein Kollege oder Familienmitglied nicht lesen soll, verwenden Sie ein sicheres Passwort, verzichten Sie auf KI-Training und beschränken Sie sich darauf den Zugriff der App auf andere mobile Funktionen wie Ihren Standort, Ihr Mikrofon und Ihre Kamera.

„Sie sollten für coole neue Technologien nicht mit Ihrer Sicherheit oder Ihrer Privatsphäre bezahlen müssen“, heißt es in dem Bericht abschließend.