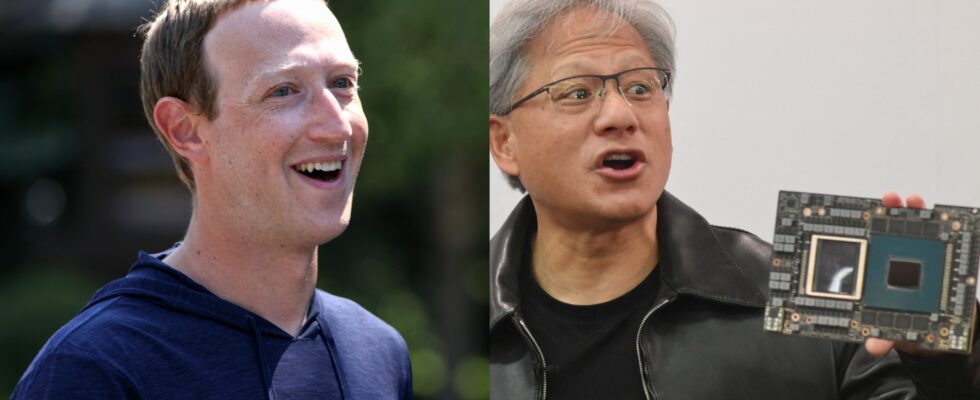

Kevin Dietsch, Getty Images; Sam Yeh

- Berichten zufolge wird Meta in diesem Jahr mehr als 340.000 der begehrten H100-Chips von Nvidia besitzen.

- Meta schätzt, dass es bis Ende 2024 einen Gesamtvorrat von 600.000 Chips haben wird, berichtete The Verge.

- CEO Mark Zuckerberg strebt danach, Meta zu einem AI-first-Unternehmen zu machen.

Meta ist auf dem besten Weg, Hunderte und Tausende begehrter Halbleiter zu horten, um in den KI-Kriegen voranzukommen.

Der Technologieriese wird bis Ende 2024 über mehr als 340.000 Nvidia H100-GPUs verfügen – die wichtigsten Chips, die Unternehmen wie OpenAI zum Trainieren und Bereitstellen von KI-Modellen wie ChatGPT verwenden –, sagte Mark Zuckerberg Der Rand.

Und das ist nicht alles. CEO Zuckerberg geht davon aus, dass Meta bis zum Jahresende insgesamt 600.000 GPUs angehäuft haben wird, darunter Nvidias A100s und andere KI-Chips.

Die Details kommen, während Unternehmen darum kämpfen, Nvidias begrenzten Vorrat an KI-Chips in die Hände zu bekommen, um die besten Produkte zu bauen. Die Produkte des Unternehmens erfreuen sich bei großen Unternehmen und Start-ups einer so hohen Nachfrage, dass der Aktienbestand in den letzten 12 Monaten um über 200 % gestiegen ist. Insgesamt übersteigt die weltweite Nachfrage nach Halbleitern die Produktion.

Und es scheint, dass Meta auf der Chip-Front der KI-Kurve voraus ist. Im Jahr 2023 lieferte Nvidia laut Angaben 150.000 seiner H100-Chips an Meta Daten von Omdia Research erhalten von The Verge. Das ist dreimal mehr als bei Unternehmen wie Google, Amazon und Oracle, schätzt Omdia. Lediglich Microsoft erhielt einen ähnlichen Betrag wie Meta.

H100-Chips kosten jeweils zwischen 25.000 und 40.000 US-Dollar, berichtete CNBC im November unter Berufung auf Schätzungen von Raymond James.

Metas Chipberg weist auf die Strategie des Unternehmens hin, ein AI-first-Unternehmen zu werden. Im vergangenen Juli stellte Meta sein großes Sprachmodell Llama 2 der Öffentlichkeit vor, das mit dem GPT-4-Modell von OpenAI konkurriert, das ChatGPT antreibt. Im September veröffentlichte Meta seine neueste Version der Ray-Ban Smart Glasses, einschließlich eines KI-Assistenten. Im selben Monat stellte das Unternehmen auch seine prominenten KI-Chatbots vor, die auf Messenger und WhatsApp verfügbar sind. Es trainiere jetzt Lama 3, sagte Zuckerberg.

Zuckerberg ist auf der Suche nach einer noch intelligenteren KI-Technologie – von einigen Experten als AGI oder künstliche allgemeine Intelligenz bezeichnet. Laut The Verge hat der CEO noch nicht definiert, wie das aussehen wird und auch nicht, wann es eintreffen wird, sieht die letztendliche Einführung jedoch als einen schrittweisen Prozess.

„Ich bin mir nicht wirklich sicher, ob sich eine bestimmte Schwelle so tiefgreifend anfühlen wird.“

Meta reagierte nicht sofort auf die Bitte von Business Insider um einen Kommentar vor der Veröffentlichung. Nvidia lehnte eine Stellungnahme ab.

Trotz der anhaltenden Halbleiterknappheit im Jahr 2023 könnte es für Technologiekäufer in diesem Jahr bergauf gehen.

Im vergangenen September sagte Kevin Scott, Chief Technology Officer von Microsoft, dass es für das Technologieunternehmen einfacher sei, an die Chips von Nvidia zu kommen. CNBC berichtete.

Dennoch sagte Zuckerberg, dass Metas aktuelles Arsenal an Nvidia-KI-Chips für andere Unternehmen, die von dem Hype profitieren wollen, Ärger bedeuten könnte.

„Wir haben die Kapazitäten aufgebaut, dies in einem Ausmaß zu tun, das möglicherweise größer ist als jedes andere einzelne Unternehmen“, sagte er gegenüber The Verge. „Ich denke, dass viele Leute das vielleicht nicht zu schätzen wissen.“