YSie sitzen am Steuer Ihres Autos, sind aber erschöpft. Ihre Schultern beginnen zu hängen, Ihr Nacken beginnt zu hängen, Ihre Augenlider rutschen nach unten. Als Ihr Kopf nach vorne neigt, weichen Sie von der Straße ab, rasen durch ein Feld und prallen gegen einen Baum.

Was aber, wenn das Überwachungssystem Ihres Autos die verräterischen Anzeichen von Müdigkeit erkennt und Sie stattdessen auffordert, von der Straße abzukommen und zu parken? Die Europäische Kommission hat gesetzlich vorgeschrieben, dass ab diesem Jahr neue Fahrzeuge mit Systemen ausgestattet werden müssen, die abgelenkte und schläfrige Fahrer auffangen, um Unfälle zu vermeiden. Jetzt trainieren eine Reihe von Start-ups künstliche Intelligenzsysteme, um die Werbegeschenke in unserer Mimik und Körpersprache zu erkennen.

Diese Unternehmen verfolgen einen neuartigen Ansatz für den Bereich der KI. Anstatt Tausende von realen Fahrern beim Einschlafen zu filmen und diese Informationen in ein Deep-Learning-Modell einzuspeisen, um die Anzeichen von Schläfrigkeit zu „lernen“, erstellen sie Millionen von gefälschten menschlichen Avataren, um die Schlafsignale nachzuspielen.

„Big Data“ definiert das Feld der KI nicht ohne Grund. Um Deep-Learning-Algorithmen genau zu trainieren, müssen die Modelle über eine Vielzahl von Datenpunkten verfügen. Das schafft Probleme bei einer Aufgabe wie dem Erkennen einer am Steuer einschlafenden Person, was in Tausenden von Autos schwierig und zeitaufwändig zu filmen wäre. Stattdessen haben Unternehmen damit begonnen, virtuelle Datensätze zu erstellen.

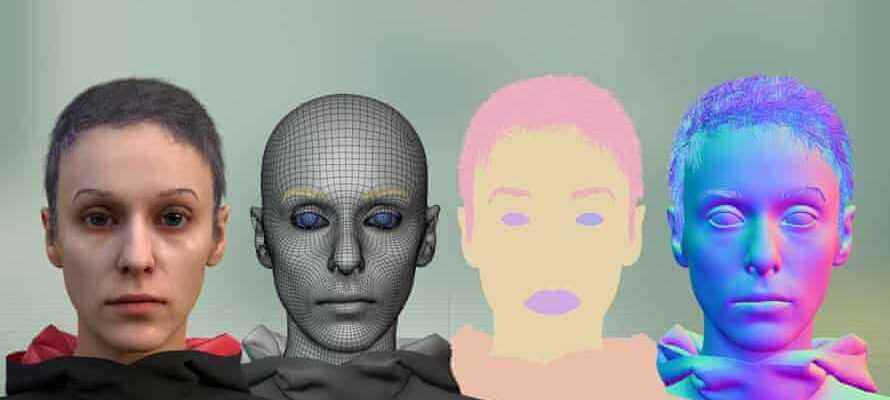

Synthese KI und Datengen sind zwei Unternehmen, die Ganzkörper-3D-Scans, einschließlich detaillierter Gesichtsscans, und Bewegungsdaten verwenden, die von Sensoren erfasst werden, die am ganzen Körper angebracht sind, um Rohdaten von echten Menschen zu sammeln. Diese Daten werden durch Algorithmen gespeist, die verschiedene Dimensionen um ein Vielfaches optimieren, um Millionen von 3D-Darstellungen von Menschen zu erstellen, die Charakteren in einem Videospiel ähneln und in einer Vielzahl von Simulationen unterschiedliche Verhaltensweisen zeigen.

Falls jemand am Steuer einschläft, könnten sie einen menschlichen Darsteller beim Einschlafen filmen und dies mit Bewegungserfassung, 3D-Animationen und anderen Techniken kombinieren, die zum Erstellen von Videospielen und Animationsfilmen verwendet werden, um die gewünschte Simulation zu erstellen. „Du kannst kartieren [the target behaviour] über Tausende von verschiedenen Körpertypen, verschiedene Winkel, unterschiedliche Beleuchtung und fügen Sie der Bewegung auch Variabilität hinzu“, sagt Yashar Behzadi, CEO von Synthesis AI.

Durch die Verwendung synthetischer Daten wird ein Großteil der Unordnung der traditionelleren Methode zum Trainieren von Deep-Learning-Algorithmen vermieden. Typischerweise müssten Unternehmen eine riesige Sammlung von Filmmaterial aus dem wirklichen Leben anhäufen, und schlecht bezahlte Arbeiter würden jeden der Clips mühsam beschriften. Diese würden in das Modell eingespeist, das lernen würde, die Verhaltensweisen zu erkennen.

Der große Vorteil des synthetischen Datenansatzes ist, dass er bei weitem schneller und billiger ist. Aber diese Unternehmen behaupten auch, dass es helfen kann, die Voreingenommenheit zu bekämpfen, die KI-Entwicklern große Kopfschmerzen bereitet. Es ist gut dokumentiert, dass einige KI-Gesichtserkennungssoftware schlecht darin ist, bestimmte demografische Gruppen zu erkennen und korrekt zu identifizieren. Dies liegt in der Regel daran, dass diese Gruppen in den Trainingsdaten unterrepräsentiert sind, was bedeutet, dass die Software diese Personen eher falsch identifiziert.

Niharika Jain, Software-Ingenieurin und Expertin für geschlechtsspezifische und rassistische Vorurteile beim generativen maschinellen Lernen, hebt das berüchtigte Beispiel der „Blink Detection“-Funktion von Nikon Coolpix hervor, die, weil die Trainingsdaten eine Mehrheit weißer Gesichter enthielten, Gesichter überproportional als asiatisch beurteilte blinken. „Ein gutes Fahrerüberwachungssystem muss verhindern, dass Mitglieder einer bestimmten Bevölkerungsgruppe fälschlicherweise häufiger schlafen als andere“, sagt sie.

Die typische Antwort auf dieses Problem besteht darin, mehr Daten von den unterrepräsentierten Gruppen in realen Umgebungen zu sammeln. Aber Unternehmen wie Datagen sagen, dass dies nicht mehr notwendig ist. Das Unternehmen kann einfach mehr Gesichter aus den unterrepräsentierten Gruppen erstellen, was bedeutet, dass sie einen größeren Anteil des endgültigen Datensatzes ausmachen. Echte 3D-Gesichtsscandaten von Tausenden von Menschen werden zu Millionen von KI-Kompositen verarbeitet. „Es gibt keine in die Daten eingebrannte Voreingenommenheit; Sie haben die volle Kontrolle über Alter, Geschlecht und ethnische Zugehörigkeit der Menschen, die Sie generieren“, sagt Gil Elbaz, Mitbegründer von Datagen. Die gruseligen Gesichter, die auftauchen, sehen nicht wie echte Menschen aus, aber das Unternehmen behauptet, dass sie ähnlich genug sind, um KI-Systemen beizubringen, wie sie in ähnlichen Szenarien auf echte Menschen reagieren sollen.

Es gibt jedoch einige Debatten darüber, ob synthetische Daten wirklich Verzerrungen beseitigen können. Bernease Herman, Datenwissenschaftlerin am eScience Institute der University of Washington, sagt, dass synthetische Daten zwar die Robustheit von Gesichtserkennungsmodellen bei unterrepräsentierten Gruppen verbessern können, sie aber nicht glaubt, dass synthetische Daten allein die Lücke zwischen der Leistung bei diesen Gruppen schließen können und Andere. Obwohl die Unternehmen manchmal wissenschaftliche Arbeiten veröffentlichen, die zeigen, wie ihre Algorithmen funktionieren, sind die Algorithmen selbst proprietär, sodass Forscher sie nicht unabhängig bewerten können.

In Bereichen wie der virtuellen Realität sowie der Robotik, in denen 3D-Mapping wichtig ist, argumentieren Unternehmen für synthetische Daten, dass es tatsächlich vorzuziehen sein könnte, KI in Simulationen zu trainieren, insbesondere da sich 3D-Modellierung, visuelle Effekte und Spieltechnologien verbessern. „Es ist nur eine Frage der Zeit, bis… Sie diese virtuellen Welten erschaffen und Ihre Systeme vollständig in einer Simulation trainieren können“, sagt Behzadi.

Diese Art des Denkens gewinnt in der autonomen Fahrzeugindustrie an Boden, wo synthetische Daten dazu beitragen, der KI von selbstfahrenden Fahrzeugen das Navigieren auf der Straße beizubringen. Der traditionelle Ansatz – stundenlanges Fahrmaterial zu filmen und dieses in ein Deep-Learning-Modell einzuspeisen – reichte aus, um Autos relativ gut für die Straßennavigation zu machen. Aber das Problem, das die Branche ärgert, ist, wie Autos dazu gebracht werden können, zuverlässig mit so genannten „Edge Cases“ umzugehen – Ereignisse, die so selten sind, dass sie in Millionen von Stunden Trainingsdaten nicht oft vorkommen. Zum Beispiel ein Kind oder ein Hund, der auf die Straße läuft, komplizierte Straßenarbeiten oder sogar einige Leitkegel, die an einer unerwarteten Position platziert sind, was genug war ein fahrerloses Waymo-Fahrzeug zu überrumpeln in Arizona im Jahr 2021.

Mit synthetischen Daten können Unternehmen endlose Variationen von Szenarien in virtuellen Welten erstellen, die in der realen Welt selten vorkommen. „Anstatt Millionen weiterer Kilometer zu warten, um mehr Beispiele zu sammeln, können sie künstlich so viele Beispiele wie nötig aus dem Randfall für Training und Tests generieren“, sagt Phil Koopman, außerordentlicher Professor für Elektro- und Computertechnik an der Carnegie Mellon Universität.

AV-Unternehmen wie Waymo, Cruise und Wayve setzen zunehmend auf reale Daten kombiniert mit simuliertem Fahren in virtuellen Welten. Waymo hat eine simulierte Welt mit KI- und Sensordaten geschaffen, die von seinen selbstfahrenden Fahrzeugen gesammelt wurden, komplett mit künstlichen Regentropfen und Sonnenblendung. Es nutzt dies, um Fahrzeuge auf normale Fahrsituationen sowie die kniffligeren Randfälle zu trainieren. Im Jahr 2021 Waymo sagte der Rand dass es 15 Milliarden Meilen Fahren simuliert hatte, im Vergleich zu nur 20 Millionen Meilen echtes Fahren.

Ein zusätzlicher Vorteil beim Testen autonomer Fahrzeuge in virtuellen Welten ist die Minimierung der Wahrscheinlichkeit sehr realer Unfälle. „Ein wichtiger Grund, warum das autonome Fahren bei vielen synthetischen Daten im Vordergrund steht, ist die Fehlertoleranz“, sagt Herman. „Ein selbstfahrendes Auto, das 1 % der Zeit oder sogar 0,01 % der Zeit einen Fehler macht, ist wahrscheinlich zu viel.“

Im Jahr 2017 war die selbstfahrende Technologie von Volvo, der man beigebracht hatte, auf große nordamerikanische Tiere wie Hirsche zu reagieren, verblüfft, als sie zum ersten Mal in Australien auf Kängurus trafen. „Wenn ein Simulator nichts über Kängurus weiß, wird keine noch so große Simulation eines erstellen, bis es in Tests zu sehen ist und die Designer herausgefunden haben, wie man es hinzufügt“, sagt Koopman. Für Aaron Roth, Professor für Computer- und Kognitionswissenschaft an der University of Pennsylvania, besteht die Herausforderung darin, synthetische Daten zu erstellen, die von echten Daten nicht zu unterscheiden sind. Er hält es für plausibel, dass wir bei Gesichtsdaten an diesem Punkt sind, da Computer jetzt fotorealistische Bilder von Gesichtern erzeugen können. „Aber für viele andere Dinge“ – zu denen Kängurus gehören oder nicht – „glaube ich, dass wir noch nicht so weit sind.“